- Nvidia-CEO Jensen Huang sagt, der Rechenbedarf für KI steige rasant, weil Modelle sich laut ihm jedes Jahr um eine Größenordnung vergrößern.

- Auf einem Live-Event in Las Vegas verwies Huang vor 2026 auf den verschärften Wettbewerb in der KI-Branche und positionierte die Nachfrage nach GPUs als zentrales Nadelöhr.

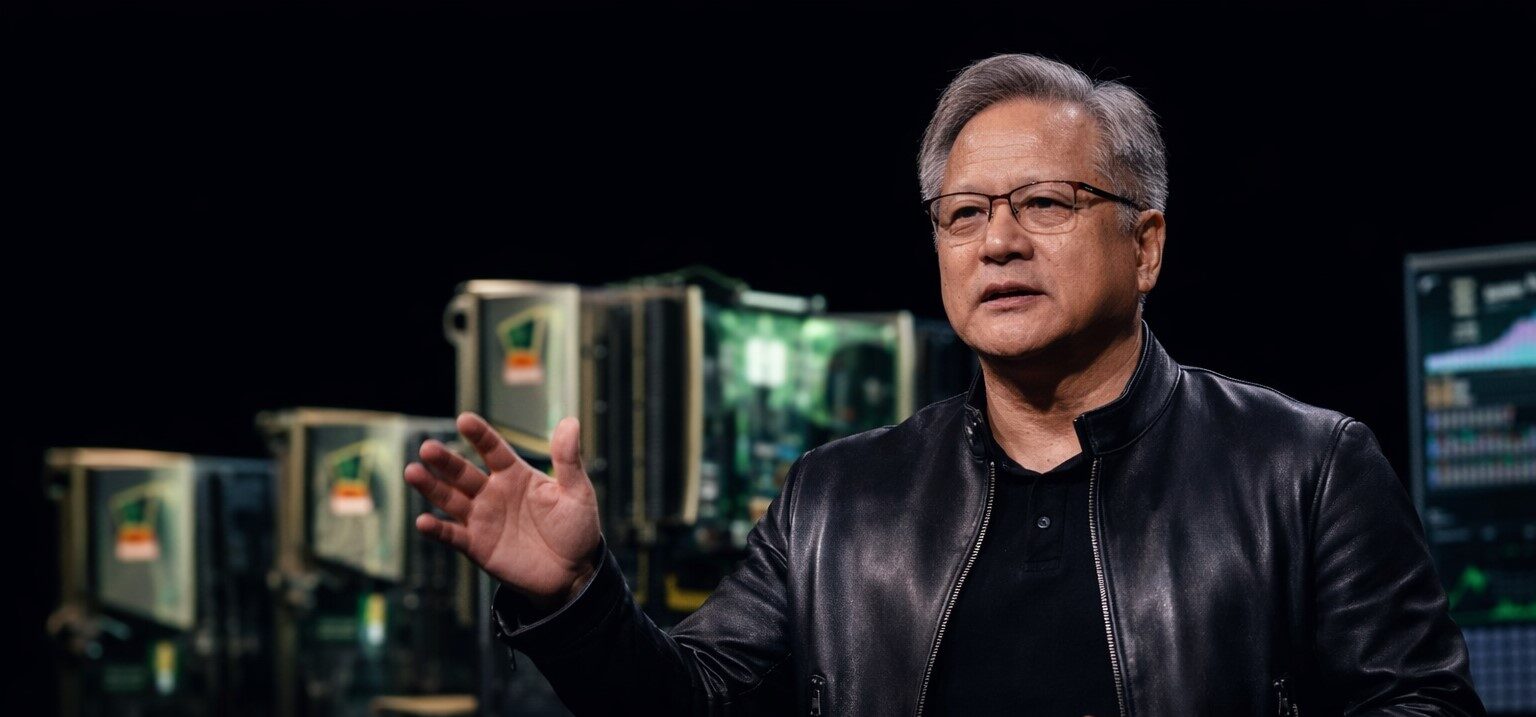

Nvidia-CEO Jensen Huang zeichnet ein vertrautes Bild, nur in größer. Auf einem Nvidia-Live-Event am Montag in Las Vegas sagte er, der Bedarf an Rechenleistung für künstliche Intelligenz steige „skyrocketing“. Das gilt, so Huang, ebenso für die Nachfrage nach Nvidia-GPUs. Der Treiber sei simpel: KI-Modelle würden jedes Jahr um den Faktor zehn wachsen, also um eine ganze Größenordnung.

Wettbewerb um die nächste KI-Stufe wird zur Hardware-Frage

Huang ordnete die Entwicklung in den Kontext eines verschärften Wettlaufs. Seit KI als Massenmarkt-Thema angekommen ist, versuche praktisch jeder, der Erste zu sein, der „das nächste Level“ erreicht. In dieser Logik ist KI weniger ein einzelnes Produkt als ein kontinuierlicher Leistungssprung, der in Trainingszyklen und Modellgrößen gemessen wird. Und diese Sprünge kosten Strom, Chips, Kapazitäten.

„All of it is a computing problem“, sagte Huang sinngemäß. Wer schneller rechnen kann, komme schneller zur nächsten Frontier. Das klingt wie eine Binsenweisheit, ist aber ein strategischer Satz. Nvidia stellt sich damit nicht als Software- oder Plattformanbieter dar, sondern als Engpass-Löser für alle, die sich im KI-Rennen nicht abhängen lassen wollen.

Warum die Chip-Nachfrage auch Finanzmärkte bewegt

Für Anleger ist die Aussage doppelt relevant. Erstens übersetzt sie den KI-Hype in eine messbare Größe, Rechenzeit, GPU-Stunden, Cluster-Ausbau. Zweitens zeigt sie, warum der Wettbewerb nicht nur über Modelle, sondern über Lieferketten und Capex entschieden wird. Wenn Modelle wirklich jährlich um eine Größenordnung wachsen, müssen Trainings- und Inferenz-Infrastrukturen mitziehen, oft schneller als Budgets geplant werden.

Das wirkt bis in andere Sektoren, Cloud-Anbieter, Rechenzentrumsbetreiber, Energieinfrastruktur. Es erklärt auch, warum „KI“ an den Märkten inzwischen wie ein Makrothema gehandelt wird. Huang nutzt die Bühne kurz vor 2026, um genau das zu betonen: Das nächste Level ist kein rein akademisches Problem. Es ist eine Frage, wer die Rechenleistung bekommt und wer warten muss.